Tensión en el Pentágono: Disputa por el uso de inteligencia artificial tras operación militar

Después de un ataque mortal en Venezuela, el Pentágono enfrenta una disputa con la empresa Anthropic sobre el control y uso de inteligencia artificial en operaciones militares y seguridad nacional.

El Pentágono enfrenta una creciente tensión interna tras el uso de inteligencia artificial (IA) en una operación militar que resultó en la muerte de decenas de guardias y militares venezolanos. La disputa se centra en el control y los principios de uso de estas tecnologías por parte de empresas proveedoras, en especial Anthropic, una de las principales desarrolladoras de sistemas de IA que colabora con el Departamento de Defensa de Estados Unidos.

El papel de la inteligencia artificial en la defensa estadounidense

La inteligencia artificial se ha convertido en un recurso clave para el Pentágono, que busca acelerar su desarrollo y aplicación en áreas como la ciberguerra, sistemas de armas autónomos y la eficiencia operativa del personal militar. Entre las empresas que proveen estas tecnologías destacan OpenAI, Google, xAI y Anthropic, esta última conocida por su enfoque en la seguridad y la ética en el desarrollo de la IA.

El modelo Claude, desarrollado por Anthropic, es uno de los pocos sistemas aprobados para su uso en redes clasificadas del Pentágono, lo que le había asegurado a la empresa un contrato valorado en 200 millones de dólares. Sin embargo, la relación se ha tensado tras la reciente operación militar contra el régimen de Nicolás Maduro en Venezuela, donde se utilizó tecnología de Palantir junto a Claude para los preparativos del asalto.

Disputa por el control y uso de la IA en operaciones militares

Fuentes cercanas a la operación revelaron que tras el ataque, que terminó con la muerte de decenas de militares venezolanos, surgieron interrogantes dentro del Departamento de Defensa sobre si Anthropic había dado su consentimiento o expresado reservas sobre el uso de su tecnología en esa acción específica. Esto generó desconfianza entre los altos mandos militares, quienes cuestionaron si la empresa podía seguir siendo un socio confiable.

Anthropic, por su parte, afirmó que no ha discutido operaciones concretas con el Departamento de Guerra ni ha manifestado preocupaciones fuera de las conversaciones técnicas habituales. La empresa mantiene que su compromiso es apoyar la seguridad nacional estadounidense, pero también ha expresado públicamente su preocupación sobre los riesgos de las armas autónomas y la vigilancia masiva habilitada por IA.

El choque de visiones sobre la IA en el Ejército

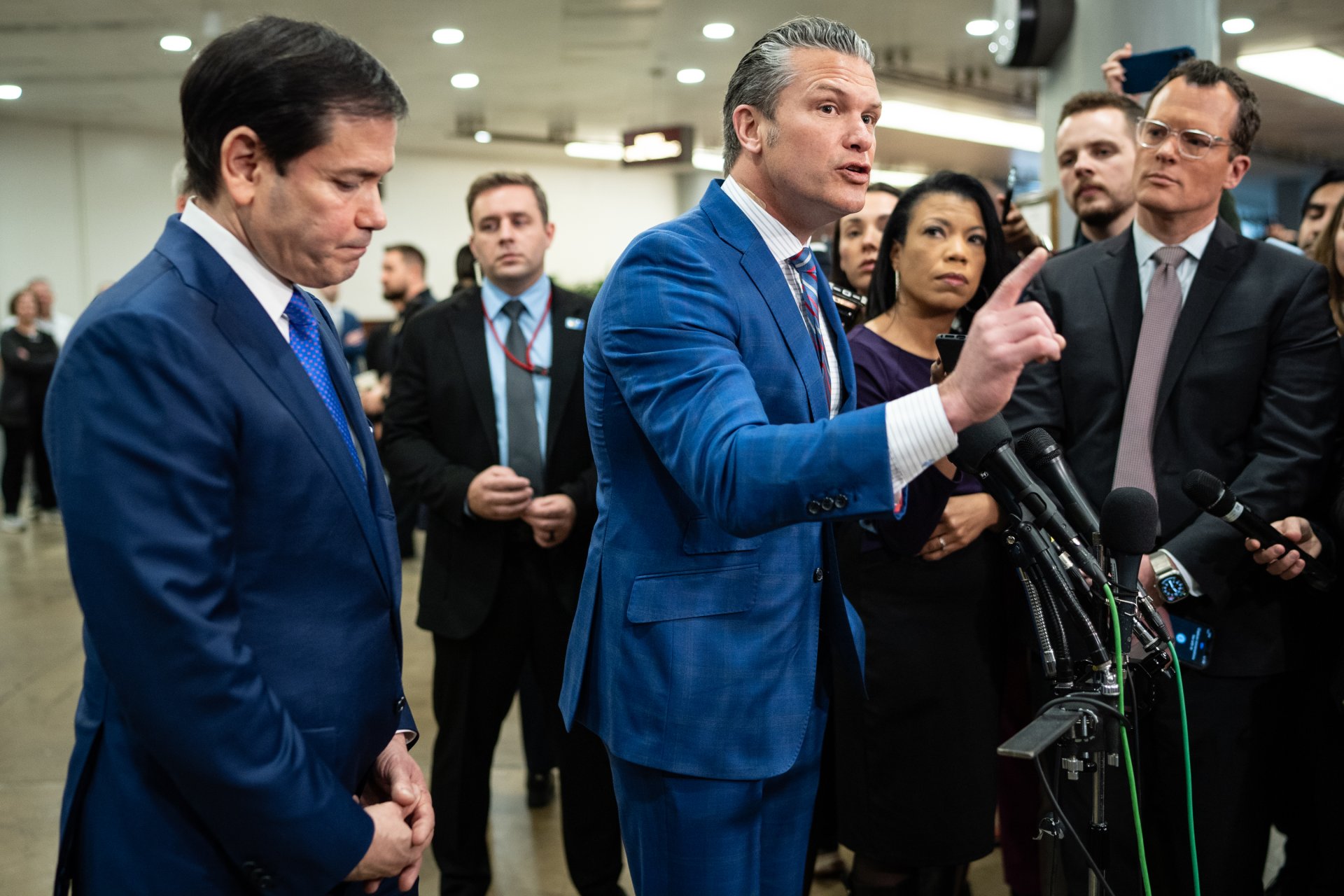

El secretario de Guerra, Pete Hegseth, ha impulsado una política de rápida adopción y despliegue de tecnologías de IA en las fuerzas armadas, argumentando que la velocidad es fundamental para mantener la superioridad frente a adversarios como China y para enfrentar amenazas emergentes como los misiles hipersónicos. Su directiva de enero de 2026 insta a pasar de la planificación a la ejecución inmediata, incluso en contextos que implican riesgos elevados.

En contraste, la postura de Anthropic refleja una cautela sobre los posibles usos indebidos de la IA, tanto por regímenes autoritarios como por gobiernos democráticos, aludiendo a un riesgo significativo de que estas tecnologías puedan volverse contra la población civil o ser usadas para ejercer un control excesivo.

Impacto y posibles repercusiones para Anthropic y el sector tecnológico

La disputa no solo pone en riesgo la continuidad del contrato millonario de Anthropic con el Pentágono, sino que también abre la puerta a una posible designación de la empresa como un "riesgo para la cadena de suministro". Esta categoría, tradicionalmente aplicada a compañías de países como China o Rusia, podría prohibir el uso de tecnología de Anthropic en sistemas militares estadounidenses y afectar a otras empresas que dependen de sus modelos de IA.

Funcionarios de Defensa han adelantado que podrían exigir a todos los proveedores y contratistas certificar que no utilizan modelos de IA de Anthropic en sus operaciones. Esta situación refleja la complejidad de equilibrar la innovación tecnológica con la seguridad nacional y el control ético en un campo tan dinámico como el de la inteligencia artificial.

Contexto histórico y avances en IA militar

El Pentágono ha incorporado IA en sus sistemas de armas desde hace años, pero la velocidad y escala actuales marcan un nuevo capítulo. La competencia con potencias como China y la evolución de amenazas tecnológicas urgentes han acelerado estos procesos. Por ejemplo, en 2024, la Fuerza Aérea estadounidense desplegó un F-16 equipado con IA capaz de superar a pilotos humanos en maniobras de combate aéreo, aunque siempre con supervisión humana directa para garantizar el control y seguridad.

Las políticas vigentes, impulsadas durante la administración Biden, requieren revisiones y salvaguardas estrictas para asegurar que los humanos mantengan el control final sobre el uso de la fuerza, una práctica que podría verse modificada en el futuro debido a las presiones de la rápida evolución tecnológica y las necesidades estratégicas.

Desafíos éticos y legales en el uso militar de la IA

Expertos y exfuncionarios recuerdan que, a diferencia de armas tradicionales, los sistemas de IA pueden actuar de maneras inesperadas y sus aplicaciones pueden ser muy diversas, lo que complica el control y la supervisión. La función del ejército, centrada en la aplicación de la violencia, implica que cualquier tecnología entregada al Departamento de Defensa probablemente será utilizada en operaciones bélicas, lo que genera interrogantes sobre la responsabilidad y el uso ético de estas herramientas.

La polémica reciente refleja la tensión entre la necesidad militar de explotar las ventajas de la IA y las preocupaciones sobre sus posibles consecuencias negativas para la seguridad global y los derechos humanos. Este debate tiene implicaciones relevantes para países como Guatemala, que observa con atención los avances y desafíos en materia de seguridad y tecnología militar a nivel internacional.

Conclusión

La disputa entre el Pentágono y Anthropic pone en evidencia los retos que enfrentan las fuerzas armadas y las empresas tecnológicas al integrar inteligencia artificial en operaciones militares sensibles. La necesidad de mantener la seguridad nacional y la superioridad estratégica se contrapone con preocupaciones éticas y de control, dando lugar a un escenario complejo que probablemente influirá en las políticas globales sobre el uso de IA en defensa en los próximos años.

Comentarios (0)

Sé el primero en comentar este artículo.

Debes iniciar sesión para poder comentar.

Iniciar sesión